手機離線跑 AI!Google Gemma 4 + AI Edge Gallery 完整解析(免網路也能用)

近年 AI 發展幾乎都依賴雲端,但現在 Google 正在顛覆這一切,透過最新的 Google AI Edge Gallery App,你已經可以在手機上「離線」直接運行 Gemma 4 大模型,不只文字對話,還能做到圖片理解、語音應用,甚至 AI Agent。

👉 換句話說:

你的手機,正在變成一台隨身 AI 伺服器。

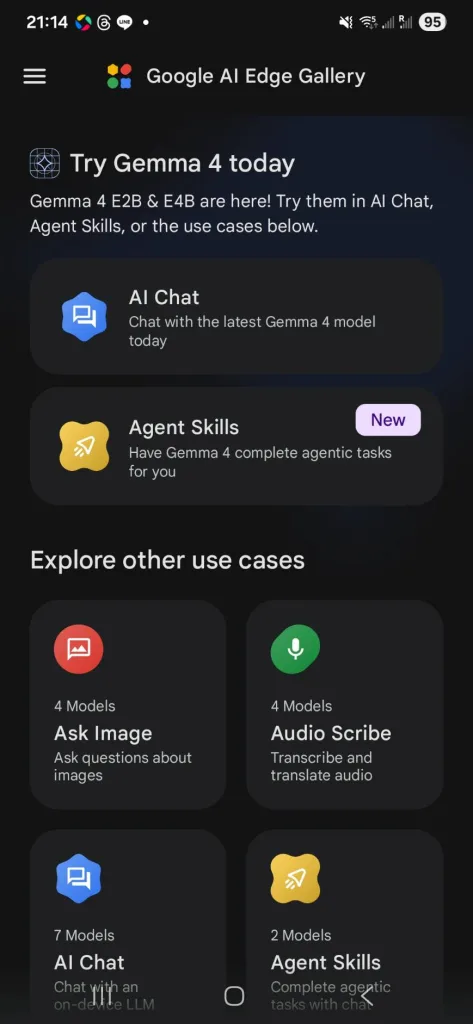

📱 什麼是 Google AI Edge Gallery?

Google AI Edge Gallery 是 Google 推出的開源應用,讓使用者可以:

- 在手機上下載 AI 模型

- 完全「離線」執行

- 不需要連網、不上傳資料

👉 也就是「On-device AI(裝置端 AI)」

📌 重點特色:

- 🔒 完全隱私(資料不離開手機)

- 📡 完全離線(無網路也能用)

- ⚡ 低延遲(不用等雲端回應)

這款 App 主打「直接在硬體上運行生成式 AI」,讓手機具備高效 AI 推理能力

🧠 Gemma 4 是什麼?為什麼這麼強?

Gemma 4 是 Google 最新開源大模型,基於 Gemini 技術打造。

👉 核心重點:

- 支援多種尺寸(可跑在手機)

- 強化推理能力與邏輯能力

- 可本地執行(Edge AI)

目前部分版本(如 E2B / E4B)已經可以在手機透過 AI Edge Gallery 直接跑

👉 簡單講:

| 類型 | 傳統 AI | Gemma 4 |

|---|---|---|

| 運算位置 | 雲端 | 本地(手機) |

| 隱私 | 低 | 高 |

| 延遲 | 高 | 低 |

| 成本 | 訂閱制 | 免費 |

🖼️ 不只是聊天:圖片+語音也能搞定

這次最關鍵的不是「能聊天」,而是👇

🔍 多模態能力(Multimodal)

Gemma 4 + Edge AI 已經可以支援:

- 📷 圖片理解(Image Recognition)

- 🎤 語音相關應用(Speech)

- 🧾 OCR / 文件理解

- 🤖 Agent 自動任務

👉 代表未來:

手機 AI 可以直接「看圖、聽聲音、做決策」

⚙️ 實際運作方式

👉 關鍵技術:

- 模型量化(Quantization)

- 邊緣推論(Edge Inference)

- NPU 加速

這也是為什麼現在手機能跑 AI 的核心原因。

🧪 實測重點

✔ 優點

- 不用網路也能用 AI

- 資料完全私密

- 速度比雲端更即時

- 免費使用

❌ 缺點

- 模型體積大(2GB~5GB)

- 手機會發熱

- 功能還在成長中

🤖 AI Agent 能力(未來最可怕的地方)

AI Edge Gallery 還支援「Agent Skills」:

- 可接工具(如地圖、知識庫)

- 可自動完成任務

- 可擴展插件

👉 官方甚至強調:

AI 可以從單純聊天變成「主動助理」

🌍 這代表什麼?(重點分析)

這不只是 App,而是產業轉折點👇

1️⃣ AI 從「雲端」走向「個人設備」

- ChatGPT → 雲端 AI

- Gemma 4 → 個人 AI

2️⃣ AI 成為手機標配(像相機一樣)

未來:

- 每支手機都有 AI

- AI 常駐本地運行

- 即時處理所有需求

3️⃣ 新創機會爆炸(你可以做)

結合你現在在做的 AI Agent / LangChain:

👉 你可以做:

- 本地 AI 房仲助理

- 離線 AI CRM

- 私有 AI 商業分析工具

- Edge AI SaaS(超有機會)

🧭 實際使用流程(超簡單)

- 安裝 App(Play Store / iOS)

- 下載模型(Gemma 4)

- 開始使用(Chat / Image / Voice)

👉 約 5 分鐘內完成

🏁 結論:AI 正在「回到你手上」

Google 這一步很關鍵:

👉 AI 不再只是雲端服務

👉 而是變成「你手機的一部分」

未來 3 年:

每個人都會有一個「離線 AI 助理」

而你現在就可以先卡位。

官方網頁

https://play.google.com/store/apps/details?id=com.google.ai.edge.gallery&pli=1

https://github.com/google-ai-edge/gallery?tab=readme-ov-file

近期留言