內容目錄

🎬 前言:影音生成進入新紀元

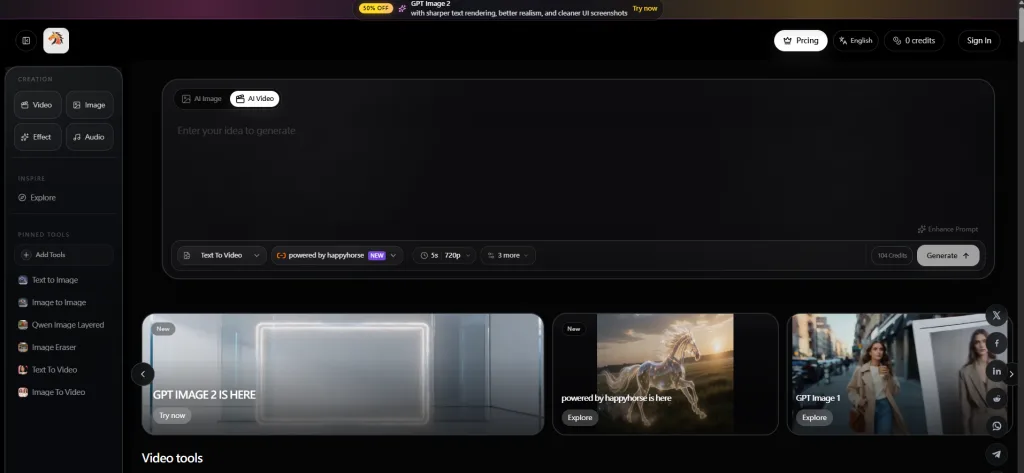

在 AI 生成技術快速進化的浪潮中,影音生成(Video Generation)一直是最具挑戰的領域之一,近期阿里巴巴推出全新開源模型 Happy Horse 1.0,不僅一舉登上視訊生成排行榜首,更以「原生音視訊同步」技術引發業界關注。

這不只是一次模型更新,而是一場技術架構的全面升級。

🧠 技術突破:原生音視訊同步與統一架構

過去的影音生成模型,多數採用「先產畫面、再加聲音」的分離式流程,導致以下問題:

- 聲音與畫面不同步

- 情緒與語境不一致

- 動作與語音對不上(例如嘴型錯誤)

而 Happy Horse 1.0 的最大突破在於:

✅ 原生音視訊同步(Native Audio-Visual Generation)

模型在同一個架構中,同步生成:

- 視訊畫面

- 聲音(語音、環境音)

👉 這代表:

- 嘴型、語氣、動作可以完全對齊

- 情境更自然、沉浸感更強

✅ 統一生成架構(Unified Architecture)

傳統模型:

Text → Image → Video → Audio

Happy Horse:

Text → Audio + Video(同步生成)

👉 好處:

- 延遲更低

- 表現更一致

- 訓練與推理效率提升

🌍 開源策略:直接撼動產業格局

這次阿里的另一個關鍵策略是——全面開源。

在目前市場上,多數高品質影音模型(如某些閉源模型)仍然:

- 無法本地部署

- API 成本高昂

- 無法自訂訓練

而 Happy Horse 1.0:

🔓 開源帶來的優勢

- 可自行部署(企業私有化)

- 可進行 fine-tune

- 可整合到自家 SaaS / Agent 系統

- 大幅降低成本

👉 對你這種正在做:

- AI Agent

- SaaS 平台(像 OpenClaw / Hermes)

- 影音生成服務

這其實是「直接可商用的關鍵拼圖」。

🧪 實測對比:各有所長,但方向已定

從目前社群與測試結果來看,Happy Horse 1.0 與其他主流模型相比:

🎥 優勢

- 音畫同步表現極佳(領先)

- 人物口型與語音一致性高

- 長影片穩定性提升

⚖️ 相對限制

- 某些細節畫質仍有進步空間

- 複雜場景(多人物)仍需優化

- 訓練與硬體需求較高

👉 結論不是「全面碾壓」,而是:

在「影音同步」這個核心維度上,已經領先一個世代。

🧩 對開發者的實際影響(重點)

如果你是開發者或創業者,這代表什麼?

💡 你現在可以做:

- AI 影片生成 SaaS(類似 Runway / Pika)

- AI 虛擬人(帶語音與表情同步)

- 自動短影音生成(TikTok / 房仲 / 行銷)

- AI 教學影片生成

👉 Happy Horse 可以直接變成:

Agent → 呼叫影音生成 API → 自動產影片

甚至可以做到:

- 「用一句話生成完整短影音廣告」

- 「AI 自動生成房仲介紹影片」

🏗️ 未來趨勢:影音生成將取代文字生成?

目前 AI 發展路線:

- 文字生成(GPT)

- 圖像生成(Stable Diffusion)

- 影音生成(下一戰場)

而 Happy Horse 代表:

🔥「影音生成正式進入可商用時代」

未來很可能出現:

- AI 直接生成 YouTube 影片

- 無人製作的短影音工廠

- AI 自動做內容變現

近期留言