by Rain Chu 5 月 25, 2026 | AI , claude , Ollama , 模型

Claude Code 最大特色之一,就是它能直接理解整個專案目錄、修改檔案、執行 CLI 指令,甚至自動修復程式碼問題。

但許多人最在意的是:

API 費用太高

原始碼不想送雲端

想完全離線使用

希望使用自己的 Local LLM

現在透過 Ollama 官方網站 與 LM Studio 官方網站 ,已經可以讓 Claude Code 直接使用本地模型。

本篇文章會完整介紹:

Claude Code 是什麼

如何讓 Claude Code 使用 Local LLM

Ollama 與 LM Studio 差異

三種實作方式

Web Search 功能啟用

常用 CLI 指令

適合的模型推薦

什麼是 Claude Code?

Claude 官方網站 的 Claude Code 是 Anthropic 推出的 AI Coding Agent。

它並不是單純聊天工具,而是:

能讀取整個專案

可修改程式碼

可執行 Terminal 指令

可自動修 Bug

可跨多檔案操作

支援 Agent Workflow

官方描述 Claude Code 是一個:

AI-powered coding assistant that helps you build features, fix bugs, and automate development tasks.

為什麼大家開始用 Local LLM?

Local LLM 的優勢非常明顯:

功能 雲端模型 Local LLM 隱私 程式碼送雲端 完全本地 費用 API Token 收費 幾乎免費 離線 不可 可 速度 看網路 本機 GPU 自訂模型 有限制 完全自由

尤其現在 Ollama 已支援 Anthropic Messages API,相容 Claude Code。

方法一:Claude + VSCode + Ollama / LM Studio

這是目前最多人使用的方法。

架構圖

Claude Code ↓VSCode Extension ↓Ollama / LM Studio ↓Local LLM 安裝流程

Step 1:安裝 Claude Code

官方下載:

Claude Download 官方下載頁面

Linux / macOS:

curl -fsSL https://claude.ai/install.sh | bash Step 2:安裝 Ollama

官方網站:

Ollama 官方網站

Linux:

curl -fsSL https://ollama.com/install.sh | sh Step 3:下載模型

推薦模型:

或:

ollama pull deepseek-coder-v2 Step 4:啟動模型

LM Studio 使用方式

如果你不喜歡 CLI,可以使用 LM Studio。

LM Studio 官方網站

LM Studio 特點:

GUI 操作

支援 OpenAI API

支援本地 Server

支援 GPU Offload

Windows 體驗很好

有些使用者甚至認為 LM Studio 在 Windows + iGPU 上比 Ollama 更方便。

Claude Code 連接 Ollama

設定環境變數:

export ANTHROPIC_BASE_URL=http://localhost:11434

export ANTHROPIC_AUTH_TOKEN=your_token

export CLAUDE_CODE_EFFORT_LEVEL=low 執行:

Claude Code 即會透過 Ollama 使用本地模型。

方法二:使用 ollama launch claude

這是 Ollama 官方提供的整合方式。

官方文件:

Ollama Claude Code Integration 文件

安裝方式

更新 Ollama:

執行:

這會:

自動設定 Claude Code

自動串接 Anthropic-compatible API

使用本地模型

官方支援模型

目前官方文件中提到可搭配:

等模型。

方法三:使用 free-claude-code Gateway

GitHub:

free-claude-code GitHub 專案

這個專案本質上是一個:

Claude Code Gateway Proxy 它能:

將 Claude Code API 轉向 Local LLM

模擬 Anthropic API

轉接 Ollama / OpenAI API

避免官方限制

適合使用情境

非常適合:

本地 AI 開發環境

多模型切換

企業內網

私有化部署

AI Coding Lab

啟動方式

通常為:

git clone https://github.com/Alishahryar1/free-claude-codecd free-claude-codenpm installnpm start 再讓 Claude Code 指向 Gateway。

啟用 Ollama Web Search 功能

Ollama 現在已支援 Web Search。

官方文件:

Ollama Web Search 文件

Web Search 功能用途

可以讓 Local LLM:

搜尋最新資訊

查 Stack Overflow

查 GitHub

查文件

即時查詢

這對 Claude Code 非常重要。

因為 Coding Agent 若沒有 Web Search:

容易使用舊知識

不知道最新版套件

不知道最新 API

啟用方式

通常:

或:

export OLLAMA_WEB_SEARCH=true 依照官方文件設定即可。

推薦 Local LLM 模型

程式開發最佳選擇

模型 推薦度 特點 Qwen3-Coder ★★★★★ Coding 能力極強 DeepSeek Coder V2 ★★★★★ 開源熱門 GLM-5 ★★★★☆ 中文能力佳 Kimi K2.5 ★★★★☆ 長上下文 Gemma 3 ★★★☆☆ 輕量快速

Claude Code 常用指令

啟動 Claude Code

指定 API

ANTHROPIC_BASE_URL=http://localhost:11434 claude 指定模型

ANTHROPIC_MODEL=qwen3-coder claude 查看 Ollama 模型

啟動 Ollama Server

Ollama vs LM Studio 比較

功能 Ollama LM Studio CLI 強 普通 GUI 基本 非常完整 Windows 普通 非常好 API 強 強 Docker 強 普通 GPU 管理 CLI GUI 新手友善 中等 高

Claude Code + Local LLM 的實際優勢

1. 幾乎零成本

不再需要:

Anthropic API

OpenAI API

Token 費用

2. 完全私有化

原始碼不離開本機。

非常適合:

3. 多模型自由切換

你可以:

今天用 Qwen

明天用 DeepSeek

後天用 Kimi

不受平台限制。

我的實際建議

如果你是:

新手

建議:

因為 GUI 最簡單。

Linux / DevOps / AI 工程師

建議:

CLI 整合能力非常強。

企業環境

建議:

free-claude-code Gateway + Ollama 可做到:

API Gateway

多模型管理

權限控管

私有化部署

結論

Claude Code 正在快速成為下一代 AI Coding Agent。

而現在最重要的變化是:

Claude Code 已經不再只能綁定官方 Claude API。

透過:

Ollama

LM Studio

free-claude-code

Anthropic-compatible API

你已經可以:

完全本地化

零 API 成本

自由切換模型

保護原始碼隱私

對於 AI 開發者與工程團隊來說,這將是非常重要的開發趨勢。

下載資源

官方網站

參考資料

by Rain Chu 5 月 25, 2026 | AI , claude , 模型

Claude Code 已經不只是「在終端機裡幫你寫程式的 AI」。根據 Anthropic 官方說明,Claude Code 是一個能理解整個程式碼庫、編輯檔案、執行命令,並協助開發者完成修 Bug、加功能、自動化開發任務的 agentic coding assistant。

而近期 AI 開發社群開始討論一個更進階的概念:Claude Code Workflow

它的核心不是「再寫一段更長的 Prompt」,而是把一整套開發流程變成可以重複執行、可以追蹤、可以驗證、可以復跑的工作流。換句話說,Workflow 讓 AI 編程從「模型臨場建議」進一步走向「工程化編排」。

這對開發者、技術主管、架構師與 AI Agent 使用者來說,是非常重要的一步。

什麼是 Claude Code Workflow?

Claude Code Workflow 可以理解成一種「把 AI Agent 工作流程寫成程式」的方式。

過去我們使用 Claude Code,通常是這樣:

請幫我分析這個 GitHub 專案,找出架構問題,並提出改善建議。

這種方式雖然方便,但有幾個問題:

第一,每次執行結果可能不完全一致。

Workflow 的價值就在這裡:它把流程變成代碼,而不是只靠 Prompt。

一個 Workflow 通常會包含三個核心部分:

export default { meta: { name: "workflow-name", description: "說明這個 workflow 要做什麼" }, async run() { const result = await agent("請執行某個任務"); return result; }} 概念上,一個 Workflow 至少會有:

meta:定義名稱與描述agent():至少呼叫一個 Agent 執行任務return:把結構化結果傳回主流程

這代表 Workflow 不只是「提示詞模板」,而是一個可以持久化、版本化、重複執行的 AI 編排腳本。

為什麼 Workflow 很重要?

Claude Code 官方文件目前已經提供許多常見工作流程,例如探索程式碼、修 Bug、重構、測試、處理 PR、撰寫文件、平行 Session、Plan Mode,以及把 Claude 接進腳本與 CI 批次處理。

但 Workflow 的想像更進一步:它不是只告訴 Claude「請照這些步驟做」,而是把這些步驟寫成可執行邏輯。

這會帶來幾個關鍵改變:

1. 可重複使用

同一個 PR Review Workflow,可以套用到不同 GitHub Repository。

同一個 Deep Research Workflow,可以套用到不同技術主題。

同一個架構評審 Workflow,可以套用到不同系統設計案。

2. 可追蹤

Workflow 可以明確知道:

哪個 Agent 負責分析安全性?

這比單純 Prompt 更接近真正的軟體工程流程。

3. 可驗證

Workflow 可以設計成多階段驗證。

例如:

第一個 Agent 產生答案。

這種方式可以降低 AI 幻覺,特別適合程式碼審查、資安報告、技術研究與商業決策文件。

4. 可復跑

如果 Workflow 是 JS 腳本,它就能像程式碼一樣被 Git 管理。

你可以:

保存版本

這代表 AI Agent 的使用方式,正在從「聊天」變成「工程系統」。

如何開啟 Claude Code Workflow 實驗功能?

以下指令來自社群實測內容,目前不屬於 Anthropic 官方正式文件中明確宣告的穩定功能。因此建議把它視為「實驗性功能」,不要直接用在正式 Production 流程。

macOS / Linux

export CLAUDE_CODE_WORKFLOWS=1 接著啟動 Claude Code CLI:

Windows

SET CLAUDE_CODE_WORKFLOWS=1 接著啟動:

啟動多 Agent Workflow 的範例 Prompt

ultrawork 請為 GitHub 專案 XXX 啟動 multi agent workflow,分析程式碼品質、安全性、架構、測試覆蓋率與可維護性,最後輸出一份結構化 Review 報告。 查看 Workflow

產生或管理 Subagents

Workflow、Subagents、Skills、Agent Teams 有什麼不同?

這是最容易混淆的地方。

Claude Code 官方文件已經明確說明 Subagents、Skills、Agent Teams 的用途。Subagents 是專門處理特定任務的 AI 助手,每個 subagent 有自己的 context window、自訂系統提示、工具權限與獨立權限,適合把支線任務從主對話中分離出去。

Skills 則是透過 SKILL.md 擴充 Claude 的能力,適合把常用指令、檢查清單、多步驟程序變成可重複呼叫的技能。官方文件也提到 Skills 可以在需要時被載入,避免長篇指令一直佔用主要上下文。

Agent Teams 則是多個 Claude Code Session 的協作模式,由一個 lead session 協調工作,其他 teammate 各自在獨立 context window 中工作,並且可以彼此溝通。官方文件也明確指出,Agent Teams 與 Subagents 的差異在於:Subagents 主要回報給主 Agent,而 Agent Teams 的成員可以彼此直接溝通。

下面用簡單方式比較:

類型 核心概念 適合用途 本質 Prompt 臨時指令 單次任務、快速問答 自然語言 Skills 可重複使用的能力包 常用檢查清單、格式化、特定任務 SOP SKILL.md 指令與資源Subagents 專門任務助手 安全審查、測試分析、文件整理 獨立上下文的 AI 助手 Agent Teams 多個 Claude Code Session 協作 大型專案、多模組開發、跨層協作 多 Session 團隊 Workflow 用程式碼編排 Agent 流程 PR Review、研究、驗證、評審、循環改進 腳本化流程

最重要的差異是:

Skills 是讓 Claude 學會一種能力;Subagents 是讓 Claude 派出專門助手;Workflow 則是把整個流程寫成代碼。

Workflow 與 Subagents 的差異

Subagents 比較像「專業分工」。

例如:

一個 security-reviewer subagent 專門看資安問題。

但 Workflow 是「流程編排」。

它可以決定:

先讓 Agent A 分析架構。

所以可以這樣理解:

Subagents 是工作者,Workflow 是工頭加流程圖。

Workflow 與 Skills 的差異

Skills 比較像「可重複使用的操作說明」。

例如:

/code-review/debug/loop/verify

Claude Code 官方文件也提到,Skills 可以透過 SKILL.md 建立,並在相關情境自動載入或手動呼叫。

但 Workflow 更像「可執行的流程腳本」。

Skills 通常重點在「教 Claude 怎麼做」。

所以差異可以簡化成:

Skills 是能力;Workflow 是編排。

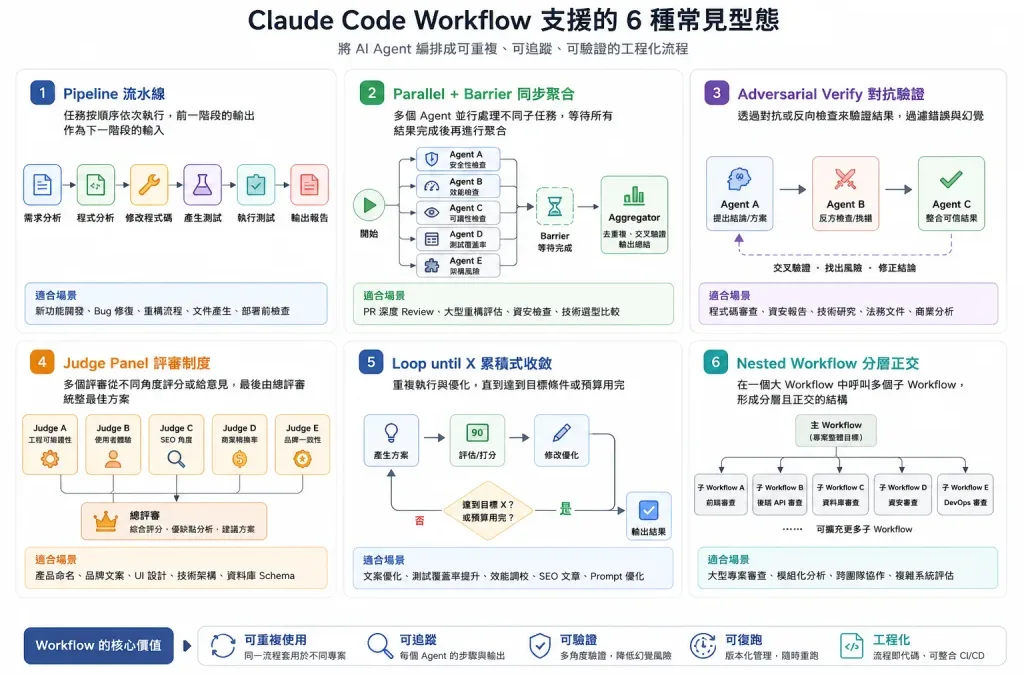

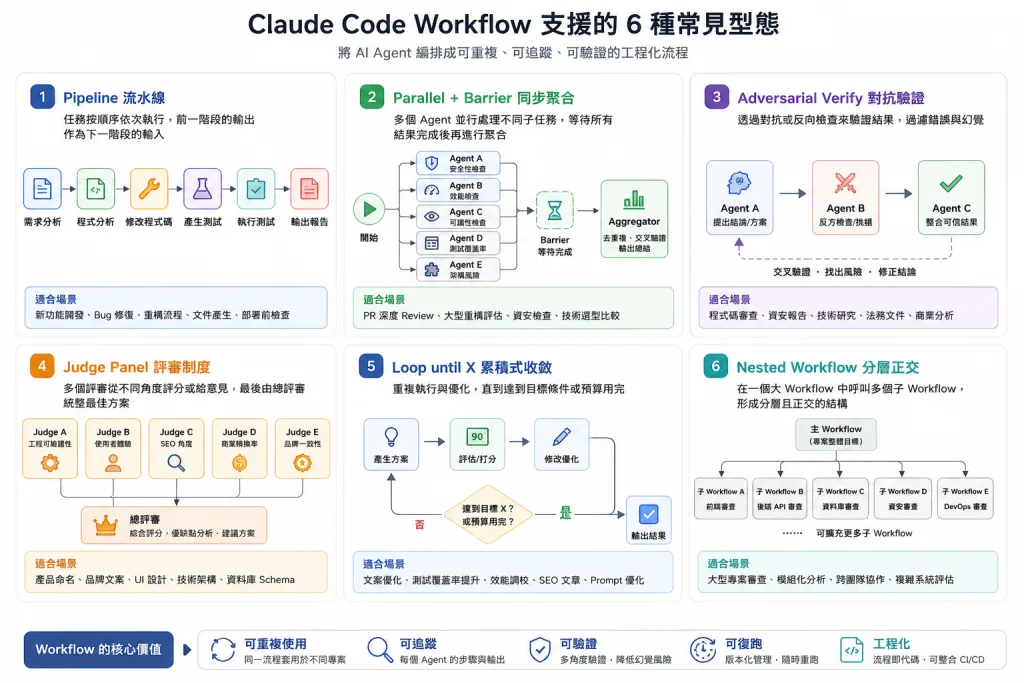

Claude Code Workflow 支援的 6 種常見型態

以下是目前最值得關注的 6 種 Workflow 型態。

Claude Code Workflow 6 types 1. Pipeline 流水線

Pipeline 是最基本的工作流型態。

它的概念是把任務拆成多個階段,前一階段的輸出會成為下一階段的輸入。

例如:

讀取需求 → 分析程式碼 → 修改程式 → 產生測試 → 執行測試 → 輸出報告 適合用在:

新功能開發

範例:

請建立一個 pipeline workflow:1. 分析目前 Repository 架構2. 找出最可能影響效能的模組3. 產生優化建議4. 修改程式碼5. 補上測試6. 回傳修改摘要 2. Parallel + Barrier 同步聚合

這種模式會同時啟動多個 Agent,等所有 Agent 都完成後,再進入下一階段。

它很適合用在需要多角度分析的任務。

例如 PR Review:

Agent A:檢查安全性Agent B:檢查效能Agent C:檢查可讀性Agent D:檢查測試覆蓋率Agent E:檢查架構風險Barrier:等待所有結果完成Aggregator:去重複、交叉驗證、輸出總結 適合用在:

PR 深度 Review

這種模式的重點是「同步聚合」。它不是誰先完成就直接輸出,而是等所有結果回來後再統整。

3. Adversarial Verify 對抗驗證

Adversarial Verify 是用來降低 AI 幻覺的重要模式。

做法是讓一個 Agent 產生答案,另一個 Agent 扮演反方、審查者或攻擊者,專門找錯。

例如:

Agent A:提出架構改善建議Agent B:找出 Agent A 的錯誤、過度假設與風險Agent C:根據 A 與 B 的結果,輸出可信版本 適合用在:

程式碼審查

這種模式的價值在於:不要只相信第一個 AI 回答,而是讓另一個 AI 專門挑戰它。

4. Judge Panel 評審制度

Judge Panel 很適合用在「沒有唯一正確答案」的任務。

例如:

產品命名

你可以設計多個評審:

Judge A:從工程可維護性評分Judge B:從使用者體驗評分Judge C:從 SEO 角度評分Judge D:從商業轉換率評分Judge E:從品牌一致性評分 最後由總評審輸出:

最佳方案

這比單一 Agent 給建議更穩定,也更適合團隊決策。

5. Loop until X 累積式收斂

Loop until X 的概念是:不斷循環改善,直到達到某個條件。

例如:

產生方案 → 評分 → 修改 → 再評分 → 達到 90 分或預算用完 → 輸出 適合用在:

文案優化

這種模式的重點是「預算控制」。

例如你可以設定:

最多跑 5 輪

這讓 AI 工作流不會無限制消耗 token 或時間。

6. Nested Workflow 分層正交

Nested Workflow 是最高階的用法。

它允許一個大 Workflow 裡面再呼叫小 Workflow。

例如:

主 Workflow:完整 SaaS 專案審查子 Workflow A:前端架構審查子 Workflow B:後端 API 審查子 Workflow C:資料庫審查子 Workflow D:資安審查子 Workflow E:DevOps 審查子 Workflow F:成本與可擴展性審查 這種方式非常適合大型專案。

因為大型任務如果全部塞進一個 Prompt,很容易失控。Nested Workflow 則可以把任務切成多個正交模組,每個模組有自己的輸入、輸出與驗證方式。

Claude Code Workflow 的常見使用場景

場景 1:GitHub PR 深度 Review

這是最典型的 Workflow 應用。

你可以讓 Workflow 自動:

分析 PR diff

範例 Prompt:

ultrawork 請針對 GitHub PR XXX 啟動 multi agent workflow,分別從安全性、效能、可維護性、測試覆蓋率與架構一致性進行審查,最後輸出一份可以貼到 PR 的 Review 報告。 場景 2:Deep Research 技術調研

Workflow 非常適合做技術研究。

例如你要研究:

LangGraph vs CrewAI vs Claude Agent SDK

Workflow 可以讓不同 Agent 分別研究:

官方文件

最後再由彙整 Agent 輸出結論。

場景 3:Harness Engineering 技術調研

如果你正在做企業級 AI Agent 平台,Workflow 可以變成一種 Harness Engineering 工具。

它可以負責:

建立研究任務

這讓技術調研不只是「問 AI 一個問題」,而是變成一套可重複執行的工程流程。

場景 4:大型重構前的風險評估

在修改大型系統前,可以先跑一個重構評估 Workflow。

例如:

請建立一個 workflow,分析目前專案是否適合把 monolith 拆成 service,請從資料庫耦合、API 邊界、部署複雜度、測試風險與團隊維護成本評估。 Workflow 可以輸出:

可重構區塊

場景 5:SEO 文章自動產製與審查

Workflow 不只適合寫程式,也可以用在內容產製。

例如:

Agent A:產生 SEO 大綱Agent B:研究搜尋意圖Agent C:撰寫文章Agent D:檢查繁體中文語氣Agent E:產生 meta descriptionAgent F:評估是否符合 E-E-A-T 最後輸出:

WordPress 文章

場景 6:AI 產品功能規格書產生

你可以把 Workflow 用在產品開發初期。

例如:

輸入一個產品想法,Workflow 自動產生:1. PRD2. User Stories3. API 規格4. Database Schema5. 前端頁面列表6. 測試案例7. 開發任務切分 這對 AI SaaS、內部系統、WordPress 外掛、企業工具都很實用。

場景 7:安全性與合規檢查

Workflow 可以設計成安全審查管線。

例如:

Agent A:檢查硬編碼密碼Agent B:檢查 SQL InjectionAgent C:檢查 XSSAgent D:檢查權限控管Agent E:檢查 Docker / CI/CD 設定Agent F:產生修補建議 適合用在:

上線前檢查

場景 8:創意應用:AI 製作人工作流

如果你正在做 AI 音樂、AI 內容或 AI 製作人系統,Workflow 也可以派上用場。

例如一首歌的產製流程可以變成:

Agent A:分析歌曲主題Agent B:產生歌詞方向Agent C:設計 Suno PromptAgent D:檢查曲風一致性Agent E:產生封面圖 PromptAgent F:產生社群貼文Judge Panel:從商業性、情緒、記憶點、品牌一致性評分 這種方式可以把創意流程產品化,不再只是單次生成。

Workflow 的核心價值:把 AI 協作變成工程資產

Claude Code Workflow 真正重要的地方,不是它多了一個指令,也不是它可以叫很多 Agent。

真正的重點是:

Workflow 讓 AI 協作流程本身變成可以保存、維護、優化與版本控制的工程資產。

這跟過去的 Prompt Engineering 很不一樣。

Prompt Engineering 重點是「如何問得更好」。

未來團隊很可能會出現這些檔案:

.github/workflows/ai-pr-review.js.claude/workflows/security-audit.js.claude/workflows/deep-research.js.claude/workflows/refactor-planner.js.claude/workflows/seo-content-pipeline.js 這些 Workflow 會像今天的 CI/CD、Lint、Test、Build Script 一樣,成為開發流程的一部分。

實務導入建議

如果你想開始使用 Claude Code Workflow,可以先從低風險場景開始。

建議順序如下:

第一階段:研究與報告

先用 Workflow 做:

技術調研

這類任務即使輸出有誤,也比較容易人工修正。

第二階段:Review 與驗證

接著導入:

PR Review

這時候建議搭配 Adversarial Verify,讓另一個 Agent 專門挑錯。

第三階段:半自動修改程式碼

最後再導入:

自動修 Bug

但這個階段一定要搭配 Git、測試、人工 Review 與權限控管。

使用 Claude Code Workflow 要注意什麼?

1. 目前仍應視為實驗功能

你提供的 CLAUDE_CODE_WORKFLOWS=1、ultrawork、/workflows 等內容,目前我沒有在 Anthropic 官方穩定文件中確認到完整正式公告。

因此建議文章中不要把它寫成「官方正式發布」,而是描述為:

「影片與社群實測發現的實驗性功能」

2. 不要讓 Workflow 直接碰 Production

Workflow 可以很強,但也代表風險更高。

建議:

只在 Git branch 執行

3. 結構化輸出很重要

Workflow 最好不要只輸出一段文章。

建議輸出:

{ "summary": "", "findings": [], "risks": [], "recommendations": [], "files_changed": [], "tests": [], "confidence": 0.87} 這樣才能被其他工具、CI/CD、Dashboard 或自動化系統接續使用。

4. 成本與 Token 要控管

多 Agent 工作流很容易消耗大量 Token。

尤其是:

Parallel + Barrier

這些模式都可能比單一 Claude Code Session 更昂貴。

所以一定要設定:

最大輪數

Claude Code 下載與官方資源

Claude 官方下載頁目前提供 macOS、Windows、Windows ARM64、iOS、Android,以及 Claude Code 的 Terminal、VS Code、JetBrains、Slack 等環境入口。官方頁面也顯示 Linux 桌面版目前不可用,但 Claude Code Terminal 可透過官方入口安裝。

Claude Code 官方文件也提供 Common workflows、Skills、Subagents、Agent Teams 等開發者文件,可作為學習 Claude Code 工作模式的基礎。

Workflow 是 Claude Code 繼 MCP、Skills、Subagents 之後的重要演進

Claude Code Workflow 的概念,代表 AI 編程正在進入下一個階段。

第一階段是聊天式 AI:你問,它答。

如果說 Prompt 是個人技巧,Workflow 就是團隊工程資產。

未來 GitHub 上很可能會出現大量開源 Claude Code Workflow,例如:

PR Review Workflow

對開發者來說,這不只是多一個 Claude Code 小技巧,而是 AI Agent 工程化的重要方向。

Claude Code Workflow 的關鍵價值可以濃縮成一句話:

把 AI 編程從「一次性的對話」升級成「可重複、可追蹤、可驗證、可復跑的工程流程」。

這也是 AI 編程真正走向團隊化、標準化與產品化的開始。

by Rain Chu 5 月 13, 2026 | AI , Ollama , 模型

最新的 Qwen 3.6,在 Ollama 上的表現,可以說是目前「本地 Coding 模型」中非常強勢的一個系列。

如果你正在使用:

NVIDIA Spark

RTX 顯卡

Ollama

OpenWebUI

Continue

Claude Code

OpenHands

Hermes Agent

Cursor 類工具

Apple

那麼 Qwen 3.6 幾乎一定值得研究。

這篇文章會完整解析:

Qwen 3.6 每個版本差異

27B 與 35B 的差異

MXFP8、NVFP4、BF16 是什麼

哪個最適合寫程式

NVIDIA Spark 最推薦的配置

Ollama 部署建議

多人 SaaS / AI Agent 最佳實務

什麼是 Qwen 3.6?

Qwen 是阿里巴巴推出的大型語言模型(LLM)系列。

最新的 Qwen 3.6,官方特別強調:

Agentic Coding

Repository-level Reasoning

長 Context 推理

Thinking Preservation

也就是說:

它不只是會寫程式,而是開始能理解「整個專案」。

根據官方與 Ollama 頁面資訊,Qwen 3.6 在以下方面有明顯提升:

前端工作流理解

多檔案推理

AI Agent Tool Calling

長上下文理解

歷史推理保留

Repository 級別程式分析

為什麼 Qwen 3.6 很適合 Ollama?

Qwen 3.6 最大特色之一:

就是對本地部署非常友善。

目前 Ollama 已提供大量版本:

27B

35B-A3B

Coding 版本

Vision 版本

MXFP8

NVFP4

BF16

MLX

而且幾乎都支援:

256K Context

長文本推理

本地 AI Agent

Coding Workflow

Qwen 3.6 各版本意思解析

qwen3.6:latest

這是官方最新預設版本。

特色:

適合:

但:

不是最強的 Coding 版本。

qwen3.6:27b

27B = 270億參數。

這是目前非常熱門的甜蜜點。

優點:

Coding 能力很強

推理速度快

VRAM 壓力較低

多人共享容易

非常適合:

Continue

Claude Code

VSCode AI

Agent Workflow

本地 Copilot

qwen3.6:35b

35B = 350億參數。

這類模型:

推理能力更強。

尤其在:

大型專案理解

架構設計

Refactor

多檔案分析

會比 27B 更好。

但缺點:

什麼是 Coding 版本?

例如:

qwen3.6:27b-coding-mxfp8

qwen3.6:35b-a3b-coding-nvfp4

這些是:

專門針對寫程式優化的模型。

相較一般聊天模型:

它們更擅長:

Python

TypeScript

Go

Rust

Docker

Shell

Kubernetes

Debug

Refactor

AI Agent Tool Calling

官方也特別提到:

Qwen 3.6 在 Agentic Coding 與 Repository-level reasoning 上有大幅提升。

MXFP8、NVFP4、BF16 是什麼?

很多人看到:

會很混亂。

其實這些都是:

「量化格式」。

MXFP8

例如:

qwen3.6:27b-coding-mxfp8

這是 NVIDIA 新世代 FP8 格式。

特色:

品質高

VRAM 使用合理

推理速度快

非常適合 NVIDIA GPU

目前很多人認為:

MXFP8 是本地 AI Coding 的最佳甜蜜點。

尤其適合:

NVIDIA Spark

RTX 4090

RTX 5090

多 Agent Workflow

NVFP4

例如:

qwen3.6:27b-coding-nvfp4

這是 NVIDIA 的 4-bit 浮點量化格式。

特色:

但:

推理品質會稍微下降。

比較適合:

SaaS 平台

多人 AI IDE

高併發 Agent

目前學術研究也開始針對 NVFP4 做最佳化。

BF16

例如:

qwen3.6:27b-coding-bf16

這幾乎是:

接近原始精度。

優點:

品質最高

reasoning 最穩

hallucination 較少

缺點:

適合:

MLX 是什麼?

MLX 是 Apple Silicon 專用。

例如:

什麼是 A3B?

例如:

qwen3.6:35b-a3b-coding-mxfp8

這代表:

MoE(Mixture of Experts)架構。

意思是:

模型總參數很大,但每次只啟用部分專家。

優點:

官方指出:

Qwen3.6-35B-A3B 僅啟動約 3B Active Parameters,但依然能超越部分大型 Dense 模型。

NVIDIA Spark 最推薦哪個?

如果你的環境是:

NVIDIA Spark

CUDA 13

128GB RAM

Ollama

OpenWebUI

Continue

Claude Code

OpenHands

那我目前最推薦:

🥇 最推薦:qwen3.6:27b-coding-mxfp8

推薦原因:

Coding 非常強

推理速度快

VRAM 不容易爆

Agent 很穩

長 Context 表現好

本地部署平衡最佳

這是目前真正的:

「Production Sweet Spot」。

🥈 高階推理推薦:qwen3.6:35b-a3b-coding-mxfp8

適合:

AI Agent

大型專案

架構設計

多 Repo 分析

優點:

reasoning 更強

repository 理解更強

複雜任務更穩

缺點:

🥉 多人 SaaS 推薦:qwen3.6:27b-coding-nvfp4

適合:

多人共享

SaaS

AI IDE

高併發 Agent

優點:

但:

品質會略低於 MXFP8。

我自己的實戰看法

如果你是:

「真正要拿來工作」。

我目前認為:

Qwen 3.6 已經開始接近:

「本地版 Claude Code」。

尤其:

27B Coding MXFP8。

真的已經非常強。

它最大的優勢不是單純寫程式。

而是:

能理解整個 Repo

能做 Agent 工作流

能做長 Context reasoning

能做 Tool Calling

能理解大型專案

這跟以前單純「補程式碼」的模型完全不同。

Ollama 部署建議

安裝模型

ollama pull qwen3.6:27b-coding-mxfp8 執行模型

ollama run qwen3.6:27b-coding-mxfp8 開放 API

export OLLAMA_HOST=0.0.0.0:11434 NVIDIA Spark 最佳化建議

建議環境變數:

Environment="OLLAMA_HOST=0.0.0.0:11434"

Environment="OLLAMA_NUM_PARALLEL=4"

Environment="OLLAMA_MAX_LOADED_MODELS=3"

Environment="OLLAMA_MAX_QUEUE=1024"

Environment="OLLAMA_KEEP_ALIVE=-1"

Environment="OLLAMA_FLASH_ATTENTION=1"

Environment="OLLAMA_KV_CACHE_TYPE=q8_0"

Environment="OMP_NUM_THREADS=32" 適合搭配的工具

Qwen 3.6 很適合:

Continue

Claude Code

OpenHands

Hermes Agent

OpenWebUI

Cursor 類工具

Browser-use

AI Agent Workflow

結論

如果你現在想打造:

本地 AI Coding 環境

AI Agent 平台

多人 AI IDE

本地 Claude Code

Ollama SaaS

那麼:

Qwen 3.6 幾乎是目前最值得研究的一條路。

尤其:

qwen3.6:27b-coding-mxfp8

我認為:

這是目前 NVIDIA Spark 上:

最平衡、最實用、最值得長期使用的本地 Coding 模型之一。

參考資料

近期留言