by Rain Chu 8 月 30, 2025 | AI , 圖型處理 , 數據分析

LaneSOD 是一套基於 InSPyReNet (逆向顯著性金字塔重建網路)而延伸出的開源模型,專門針對車道線分割(Lane Segmentation),應用於駕駛場景的 AI 視覺處理中。透過強大的顯著性檢測技術,LaneSOD 能精準辨識道路上的車道線,具備高準確度與可用性。

一、什麼是 LaneSOD?

核心技術 :LaneSOD 架構於 InSPyReNet,後者是一種高解析度顯著性物件偵測模型,於 ACCV 2022 上提出,專門處理高解析度圖片的顯著性檢測,使用金字塔結構融合多階層特徵提高精度。執行場景 :LaneSOD 適用於駕駛視角的車道識別,尤其在多車道或複雜光線下仍能穩定運作,是自駕輔助或智慧交通系統的理想工具。

二、快速上手:使用 LaneSOD 的流程概覽

以下以 Python + PyTorch 環境為基礎,簡述流程步驟:

安裝依賴與下載模型:

git clone https://github.com/plemeri/LaneSOD.git

cd LaneSOD

pip install -r requirements.txt 資料準備與推論:

from lanesod import LaneSODModel

model = LaneSODModel(pretrained=True)

# 載入測試影像

img = load_image("road_scene.jpg")

mask = model.predict(img)

save_image_mask("road_scene_mask.png", mask) mask 是二值化輸出,車道線處為前景。

可進行後處理(edge filtering)提升視覺辨識效果。

三、LaneSOD 的特色亮點

高解析度精準分割 :繼承 InSPyReNet 的頂尖顯著性分析能力,即使複雜場景仍保持高精度。簡易套件整合 :支援 CLI 和 Python API,開發者可快速整合至專案。應用靈活性高 :適用於單張圖片、影片逐幀處理或即時影像分析。MIT 開源授權 :自由使用並可擴展至商業應用。

四、實戰建議

強調後處理 :可搭配 OpenCV 做 morphological operations(如 dilation, erosion)強化車道線連貫性。影片整合 :巡迴處理影片每幀、並套用 temporal smoothing,可提升邊界一致性與視覺效果。多元測試場景 :建議在白天、夜晚、陰影等多樣環境下測試模型穩定性。

原始資料

https://github.com/plemeri/LaneSOD

by Rain Chu 8 月 29, 2025 | AI , 圖型處理 , 影片製作

如何輕鬆地運用 AI 技術,讓影片或直播畫面擁有透明背景 ,無需繁鎖編輯與圖層操作!今天分享的工具是使用 InSPyReNet 提供的開源套件

工具簡介:什麼是 transparent-background[webcam]?

核心技術 :基於 InSPyReNet(ACCV 2022)所提出的 AI 去背演算法,支援圖片、影片甚至 webcam 的背景移除功能 。Python 套件 :名稱為 transparent-background,採 MIT 授權,可自由商業使用。強大特色 :

支援多種輸出模式:如 RGBA(透明背景)、saliency map、綠幕、背景模糊、overlay 等。

支援 webcam 輸入,但 Linux 上需安裝 v4l2loopback 才能建立虛擬攝影機

安裝與依賴設定(含 webcam 支援)

安裝套件 :

pip install transparent-background[webcam] 若使用 Linux,請安裝 webcam relay :

git clone https://github.com/umlaeute/v4l2loopback.git && cd v4l2loopback

make && sudo make install

sudo depmod -a

sudo modprobe v4l2loopback devices=1

CLI 快速範例

transparent-background --source 0 --dest output_folder --type rgba 參數說明:

--source 0 表示 webcam 輸入(一般第一支 webcam 為 0)。--type rgba 代表輸出為帶 alpha 通道的透明背景影像。map、green、blur、overlay 或指定背景圖

用於單一影片檔案

Python API 範例:

讀取 webcam 並顯示去背畫面

import cv2

from transparent_background import Remover

remover = Remover()

cap = cv2.VideoCapture(0) # 開啟預設 webcam

while True:

ret, frame = cap.read()

if not ret:

break

# 處理去背結果(RGBA)

out = remover.process(frame, type="rgba")

cv2.imshow("Transparent Webcam", out)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

cv2.destroyAllWindows()

📖 transparent-background 參數說明

--source [SOURCE](必填)指定輸入的資料來源,可以是:

單張圖片 :例如 image.png圖片資料夾 :例如 path/to/img/folder單個影片檔 :例如 video.mp4影片資料夾 :例如 path/to/vid/folder整數 :用於指定 webcam 地址,例如 0(對應 /dev/video0 的攝影機)

--dest [DEST](可選)輸出結果存放的資料夾,若未指定,則預設為當前工作目錄 。

--threshold [THRESHOLD](可選)設定硬性去背的閾值,範圍為 0.0 ~ 1.0 。

不建議與 soft prediction 同時使用 ,若未設定,系統會使用「軟性預測」來生成更自然的透明效果。

--type [TYPE](可選)選擇輸出的背景類型,預設為 rgba:

rgba :輸出帶透明通道的影像(alpha map),若未設定 threshold,會自動透過 pymatting 進行前景提取。⚠️ 此模式不適用於影片或 webcam 。map :輸出純粹的 saliency map(灰階遮罩)。green :將背景換成綠幕。white :將背景換成純白色(由 [carpedm20] 貢獻)。‘[255, 0, 0]’ :使用指定的 RGB 顏色作為背景(需加單引號)。blur :將背景模糊處理。overlay :以半透明綠色覆蓋前景並突顯邊緣。另一張圖片 :可指定圖片路徑(例如 samples/background.png),前景會直接疊加在該背景上。

--ckpt [CKPT](可選)使用其他模型檔(checkpoint)。

--mode [MODE](可選)指定運行模式:

base :標準模式。base-nightly :使用 nightly release 版本的 checkpoint。fast :快速模式,速度快但可能在細節上略有損失。

其他選項

--resize [RESIZE]

static(預設):輸出尺寸固定。dynamic:生成更清晰的邊緣,但可能不穩定。

--format [FORMAT]--reverse前景移除 、保留背景(官方玩笑稱為「transparent-foreground」模式 😆)。--jit

範例

單張圖片去背 (輸出透明 PNG):

transparent-background --source input.png --dest output --type rgba 處理整個資料夾的圖片,並輸出模糊背景效果 :

transparent-background --source ./images --dest ./results --type blur 即時 webcam 去背 (Linux 需安裝 v4l2loopback):

transparent-background --source 0 --dest ./webcam_output --type green 更換背景為自訂圖片 :

transparent-background --source video.mp4 --dest ./output --type 'backgrounds/bg.png' GUI 模式

安裝 GUI 支援

pip install --extra-index-url https://download.pytorch.org/whl/cu118 transparent-background[gui] # with gui dependency (flet) 開啟 GUI

transparent-background-gui 官方教學

VIDEO

官方網頁

https://github.com/plemeri/transparent-background

採用的演算法

https://github.com/plemeri/InSPyReNet

開源的後製影片軟體

https://kdenlive.org

參考資料

by Rain Chu 4 月 20, 2025 | AI , 圖型處理 , 影片製作 , 繪圖

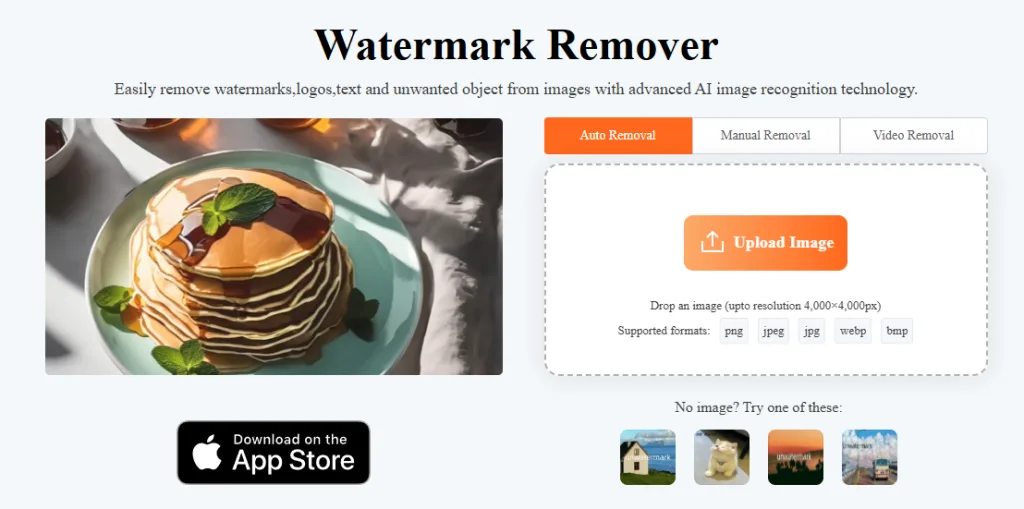

Unwatermark.a i

🧩 Unwatermark.ai 的主要特色

✅ 完全免費,無需註冊

使用 Unwatermark.ai,你不需要提供任何個人資訊或創建帳號,只需打開網站,即可立即開始使用,省去繁瑣的註冊流程。

🎨 簡單的操作介面

上傳影片後,利用畫筆或矩形工具標記想要去除的字幕區域,AI 會自動分析並去除標記區域的字幕,同時填補背景,保持影片畫質清晰自然。

📁 支援多種影片格式

Unwatermark.ai 支援 MP4、AVI、MOV 等常見影片格式,無需擔心格式相容性問題。

⚡ 快速處理,節省時間

得益於高效的 AI 演算法,Unwatermark.ai 能夠在短時間內完成字幕去除,讓你快速獲得無字幕的影片。

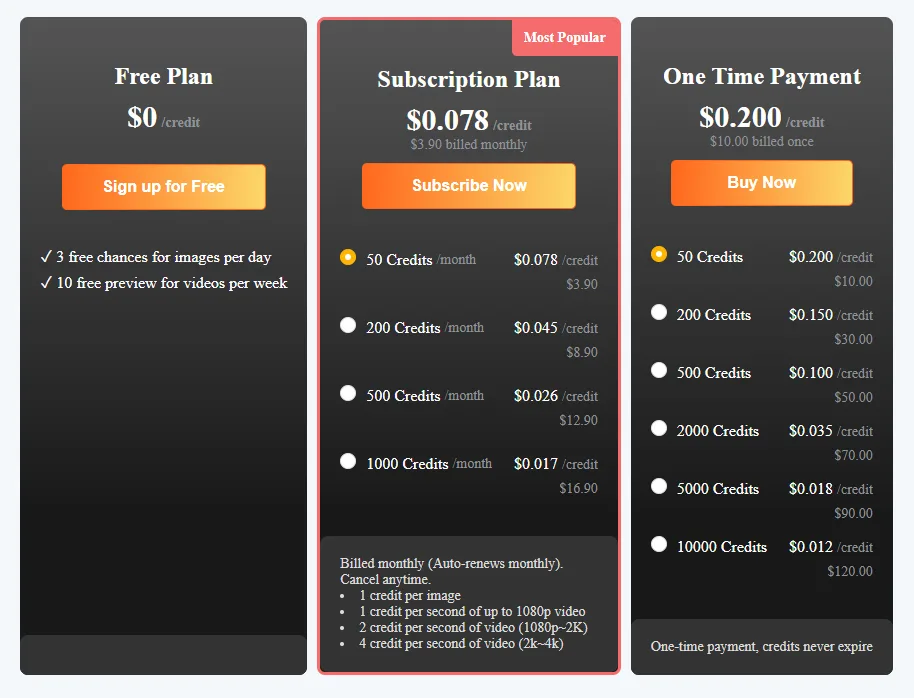

💰 價格合理,選擇多樣

除了免費使用外,Unwatermark.ai 也提供多種付費方案,滿足不同用戶的需求。

🛠️ 如何使用 Unwatermark.ai?

打開網站 :前往 Unwatermark.ai 官方網站 。上傳影片 :點擊「上傳影片」按鈕,選擇你想要去除字幕的影片。標記字幕區域 :使用畫筆或矩形工具,標記影片中需要去除的字幕位置。開始處理 :點擊「開始去除」按鈕,AI 將自動處理影片。下載影片 :處理完成後,下載無字幕的影片即可。

🎯 適合哪些人使用?

影片創作者 :需要去除原始影片中的字幕,以便重新編輯或添加新的字幕。教育工作者 :希望使用無字幕的影片作為教學素材。社群媒體使用者 :想要分享無字幕的影片,提升觀賞體驗。初學者 :沒有影片編輯經驗,但需要簡單快速地去除字幕。

參考資料

by Rain Chu 3 月 10, 2025 | AI , 圖型處理 , 影片製作

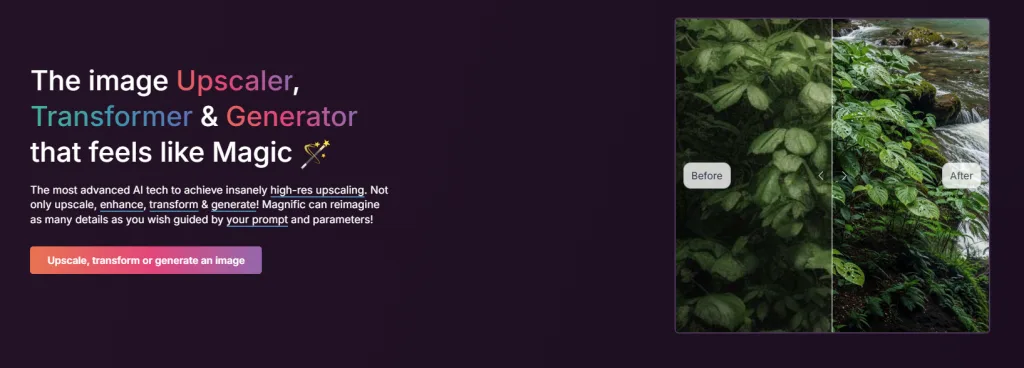

探索 Magnific 的圖片風格遷移功能

風格遷移(Style Transfer)是現在AI圖學中的一項創新技術,讓我們能夠將一張圖片的風格應用到另一張圖片上,創造出獨特且富有創意的視覺效果。Magnific 作為一款先進的 AI 圖像處理工具,近期推出了風格遷移功能,為用戶提供了更多元的創作可能性。

什麼是風格遷移?

風格遷移是一種基於卷積神經網絡(CNN)的技術,通過優化目標圖像,使其在內容上接近原始圖像,在風格上接近參考圖像,從而實現風格的遷移。這意味著,我們可以將一幅畫的藝術風格應用到一張照片上,或是將某種設計風格融入到現有的圖像中,創造出全新的視覺效果。

Magnific 的風格遷移功能特色

Magnific 的風格遷移功能在保留原圖結構的同時,成功地將參考圖的風格融入其中。這使得生成的圖像既保持了原始內容的清晰度,又展現了新的風格特徵。

主要參數解讀

Style Strength(風格強度) :控制風格遷移的程度。建議初次使用時設置在 95% 左右,以最大程度地遷移參考圖的風格。Structure Strength(結構強度) :決定保留原圖結構的程度。建議設置在 85% 以上,最好是 100%,以確保輸入圖像的線條和輪廓得以保留。Portrait(肖像模式) :處理肖像時,務必啟用此選項。

Portrait Style(肖像風格) :可根據個人喜好選擇「標準」、「流行」或「超流行」。Enhance(增強) :若希望面部特徵更為明顯,可啟用此選項,但可能會導致相似度略有下降。

Fixed Generation(固定生成) :啟用後,使用相同的設置(如提示詞、風格強度等)生成的圖像將始終相同。此功能主要用於模型微調和測試。Engine(引擎) :建議選擇 Balanced(平衡)模式,效果均衡美觀,細節豐富。Real(真實)和 Super Real(超真實)適合生成寫實風格。Flavor(風味) :若希望生成的圖片風格更接近參考圖,可選擇 Faithful。若希望色彩更豐富、藝術感更強,可選擇 GenZ 或 Psychedelia。

如何使用 Magnific 的風格遷移功能

上傳圖像 :在 Magnific 的界面中,分別上傳要編輯的圖像和風格參考圖。設置參數 :切換到風格遷移功能,填寫提示詞,並根據需要設置上述參數。生成圖像 :點擊「Generate」按鈕,等待片刻,Magnific 即會生成一張融合了兩張圖片特徵的新圖像。放大與修復 :最後,可使用 Upscale 功能放大圖像並修復一些細節,特別是面部細節。

Magnific 與 Midjourney 的比較

Magnific 的風格遷移功能與 Midjourney 的風格參考功能在算法上有所不同,導致了二者的差異。Midjourney 主要使用擴散模型(Diffusion Model),通過噪聲逐步擴散和去噪的過程來生成圖像。然而,這種方法對原始圖片的結構保留得並不好,生成的圖像往往在構圖和形狀上與原圖差異較大。而 Magnific 使用的是風格遷移技術,通過優化目標圖像,使其在內容上接近原始圖像,在風格上接近參考圖像,從而實現風格的遷移。在這個過程中,原始圖像的結構信息可以得到較好的保留。

Magnific 的風格遷移功能為用戶提供了一個強大且靈活的工具,能夠在保持原圖結構的同時,實現風格的創意轉換。無論是設計師、攝影師,還是普通用戶,都可以利用這項功能。

by Rain Chu 2 月 25, 2025 | AI , 圖型處理 , 繪圖

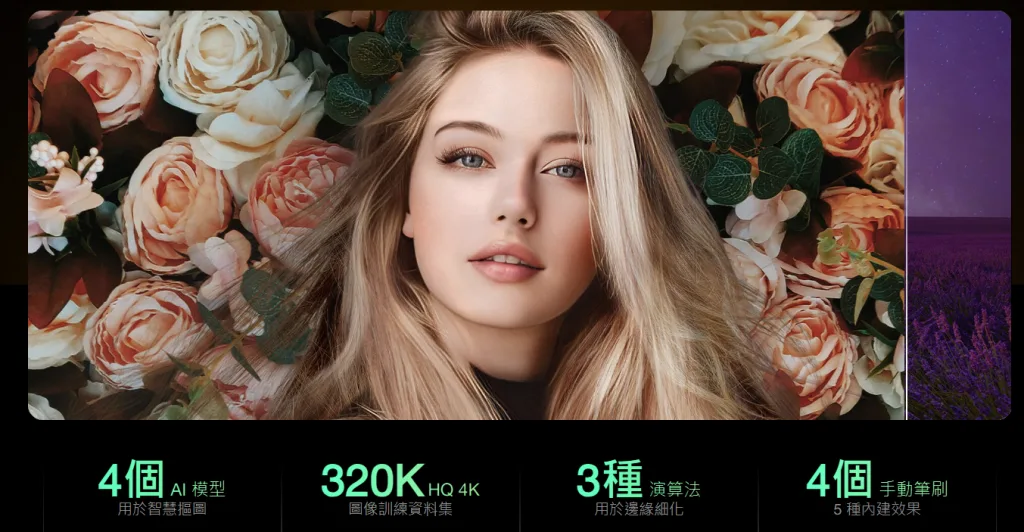

可以不要再用 photoshop 來摳圖了,Aiarty Image Matting AlphaStandard V2 在半透明物件的摳圖方面表現尤為出色,確保細節保留並與背景完美融合。

主要功能介紹

1. 多款 AI 摳圖模型 Aiarty Image Matting 提供四種 AI 模型,以應對不同類型的圖像:

AlphaStandard V2 :適用於婚紗、玻璃、水滴等半透明物件,保留細緻邊緣與透明效果。AlphaEdge V2 :針對邊緣處理優化,使摳圖效果更清晰細緻。EdgeClear V2 :適合處理 電商產品圖 ,如服飾、鞋子、包包、電子產品等。該模型可有效增強邊緣清晰度,使產品與背景分離更加自然,並去除雜訊,確保產品輪廓銳利。這對於電商平台(如 Amazon、Shopee、蝦皮、京東)上的商品展示至關重要。SolidMat V2 :專為堅固物件(如書籍、家具、衣物)設計,提供最佳輪廓識別。

2. 支援導出蒙版功能 Aiarty Image Matting 允許使用者導出 Alpha 蒙版(Mask) ,這項功能對於影像合成、特效處理和影像編輯極為重要。蒙版導出後,可在 Photoshop、Premiere Pro 或其他影像處理軟體中進一步編輯,方便用戶調整前景與背景的融合效果。

3. 高效批量處理 該工具支援一次處理多達 3000 張圖片 ,適合需要大量摳圖的設計師與影像後製團隊,大幅提升工作效率。

4. 多樣化背景處理 摳圖後的影像可選擇:

保留透明背景(.PNG)

替換純色背景

替換自定義背景(如模糊效果或其他圖片)

by rainchu 12 月 27, 2024 | AI , 人臉辨識 , 圖型處理 , 繪圖

MBG-2-Studio 是一款基於 BRIA-RMBG-2.0 模型開發的開源應用程式,專門用於高效地移除和替換圖像背景,提供了背景移除、圖像合成、顏色分級和批次處理,可以用於電子商務、廣告製作、遊戲開發等多種場景。

主要功能:

背景移除 :利用先進的 AI 技術,精確分離前景與背景,達到高精度的背景去除效果。拖放圖庫 :用戶可以直接從圖庫中拖放處理後的圖像,進行背景替換和顏色調整。圖像合成 :將處理後的圖像放置在新的背景上,並進行位置和大小的調整,以實現自然的合成效果。顏色分級 :調整圖像的亮度、對比度、飽和度、色溫和色調,提升圖像質量。批次處理 :一次性處理多張圖像,提高工作效率,適合需要大量處理的用戶。URL 支援 :直接從 URL 加載圖像進行處理,方便處理線上圖片。

使用指南: 使用 node js 安裝

安裝 :從 GitHub 頁面下載最新版本的安裝包,解壓後運行 install.js 進行安裝。啟動 :安裝完成後,運行 start.js 啟動應用程式。背景移除 :在「背景移除」標籤下,將需要處理的圖像拖放到指定區域,應用程式會自動進行背景移除。圖像合成 :在「合成工作區」標籤下,從圖庫中拖放處理後的圖像到合成區域,調整位置和大小,選擇新的背景,並使用顏色分級工具進行調整。

使用 pip 安裝

安裝: 到 app 目錄下,執行 pip install -r requirements.txt啟動: 執行 app\app.py

相關資源: GitHub 頁面

近期留言