by rainchu 8 月 27, 2024 | Agent , AI

Dify AI 是一個開放靈活的生成式 AI 應用開發框架,提供了一個全方面的解決方案,讓開發者能夠輕鬆構建和運營生成式 AI的 原生應用。平台的核心技術包括 AI 工作流程編排、RAG 檢索、模型管理等功能。Dify AI 支持從 Agent 建立到工作流程編排的完整開發過程,讓使用者可以專注於創造應用的核心價值,此外,它提供的工具包括 Prompt IDE、Enterprise LLMOps 和 BaaS 等解決方案,可以大幅度的提升開發效率並優化應用性能,可以先去Dify的GitHUB 看看。

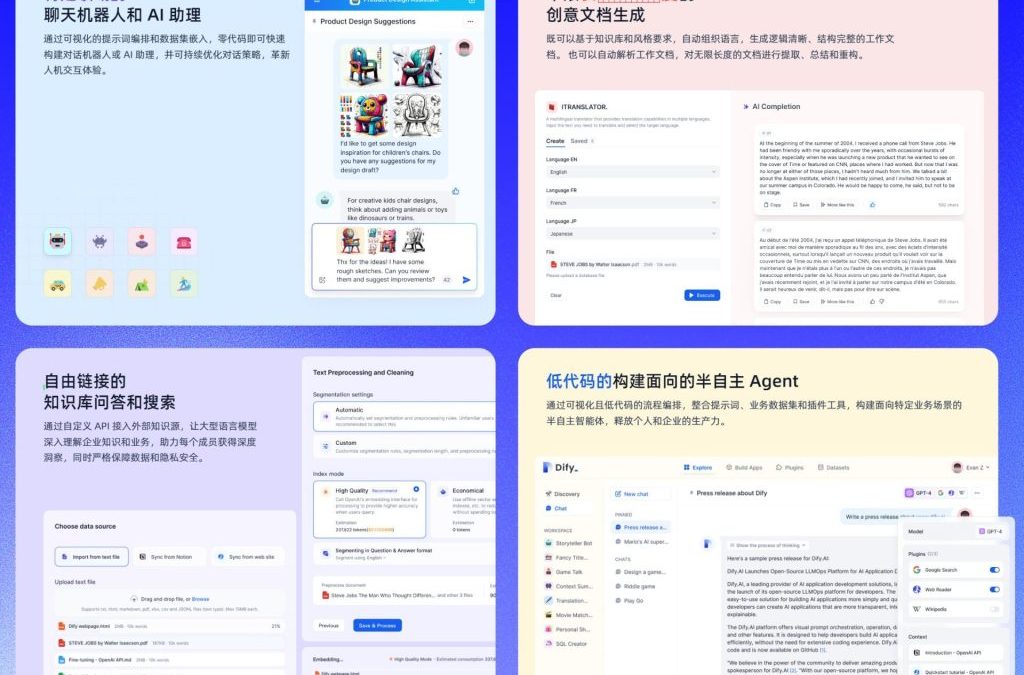

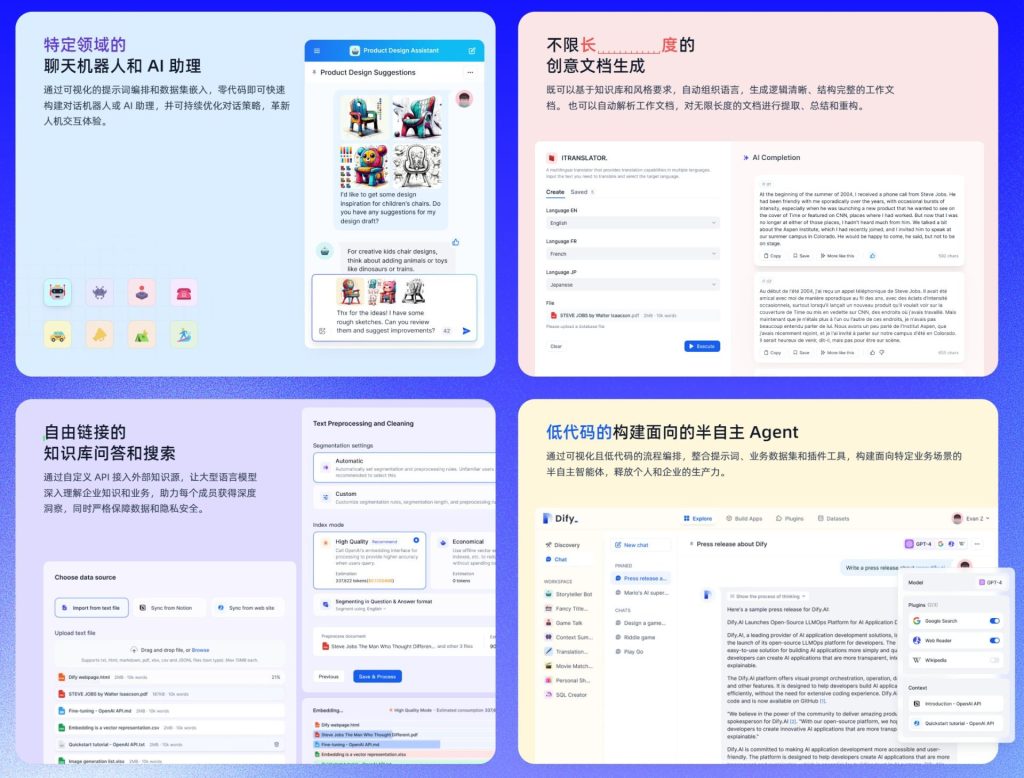

特色介紹

公司內部私有化的知識庫和AI助理 :Dify AI 允許企業將內部知識庫整合到平台中,並創建專屬的AI助理,來高效地管理和利用企業知識。

公司內部可以控管的紀錄 :企業可以通過Dify AI平台對所有操作和數據進行詳細記錄和管控,確保數據安全和合規性。

AI工作流自動化 :Dify AI 提供連結公司內部資訊系統的能力,幫助企業自動化處理各種業務流程,提升運營效率。

零代碼創建 AI Agent :平台支持用戶在無需編寫代碼的情況下,創建和部署個性化的 AI Agent,滿足各類業務需求。

支持多種大語言模型 :Dify AI 支持全球各種主流的大語言模型(LLM),為企業提供靈活的選擇,以滿足不同場景的應用需求。

開發以及運營的支持

利用 Docker 安裝

先把專案抓下來

git clone https://github.com/langgenius/dify.git 然後可以用下面的指令安裝

cd docker

cp .env.example .env

docker compose up -d 安裝完成後,利用瀏覽器看 http://localhost/install ,按照步驟設定即可

使用線上服務

https://cloud.dify.ai/apps

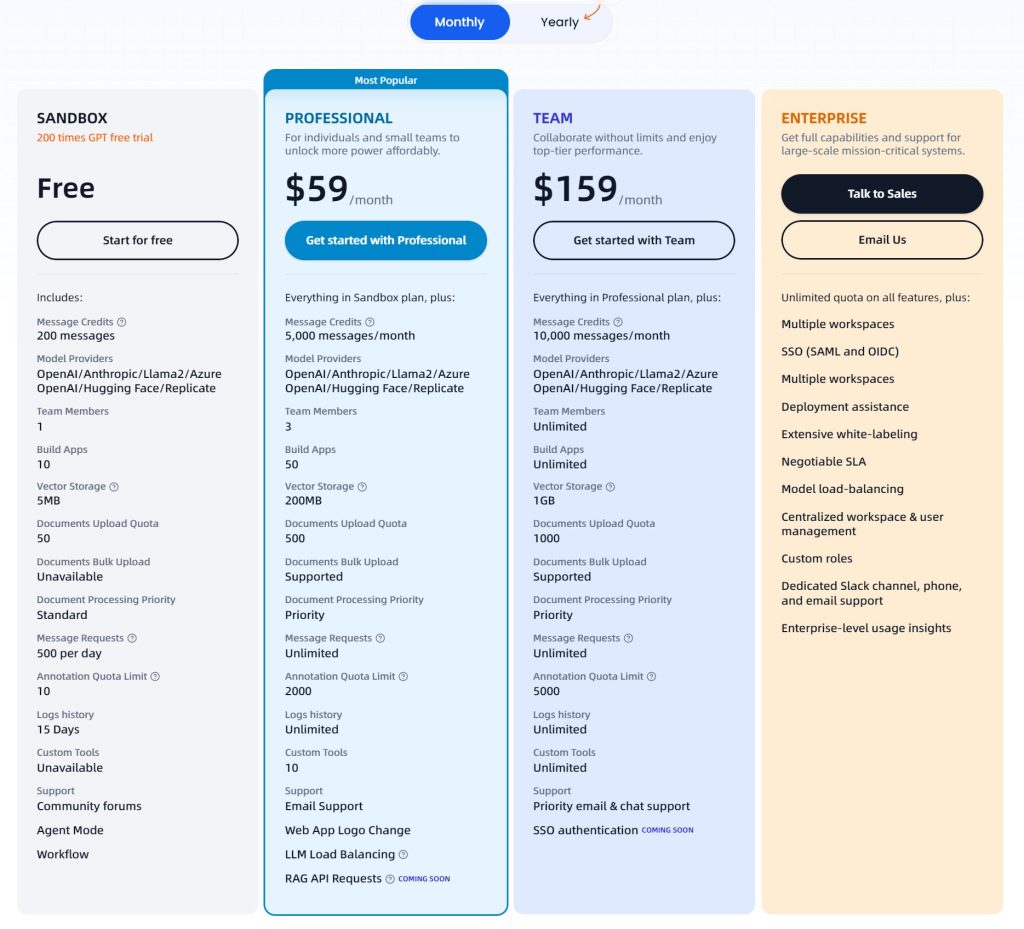

價格表

您可以在 Dify AI 官網 上了解更多詳情。

參考資料:

by rainchu 8 月 21, 2024 | AI , 繪圖

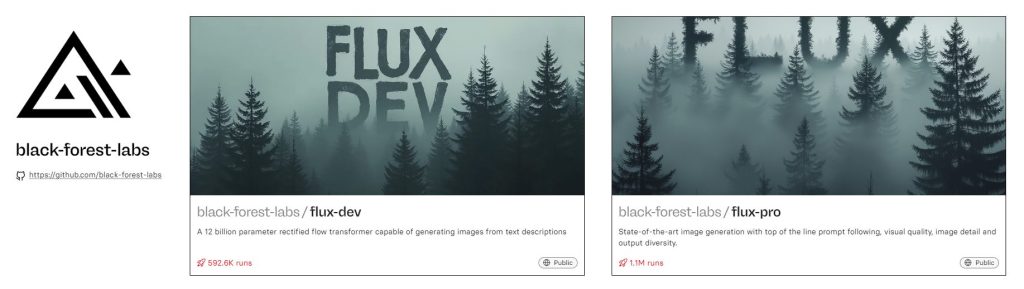

這是由黑森林實驗室所提供的 Flux API,, 原生有提供 Python, Node.js, Http 的範例,價格也很彈性,產圖的效果很好,可以不用自己組建自己的主機,就可以享有 FLUX 的繪圖能力,可以快速且容易的整合進 Dify 工作流程中

參考資料

https://replicate.com/black-forest-labs

GitHUB

定價策略

by rainchu 8 月 9, 2024 | AI , 影片製作

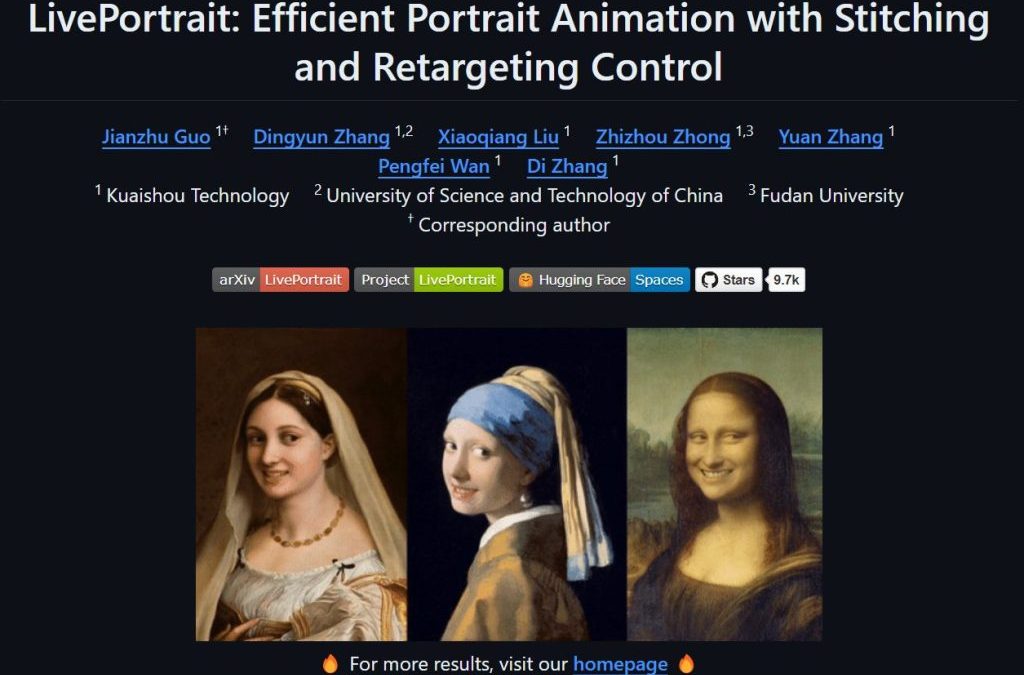

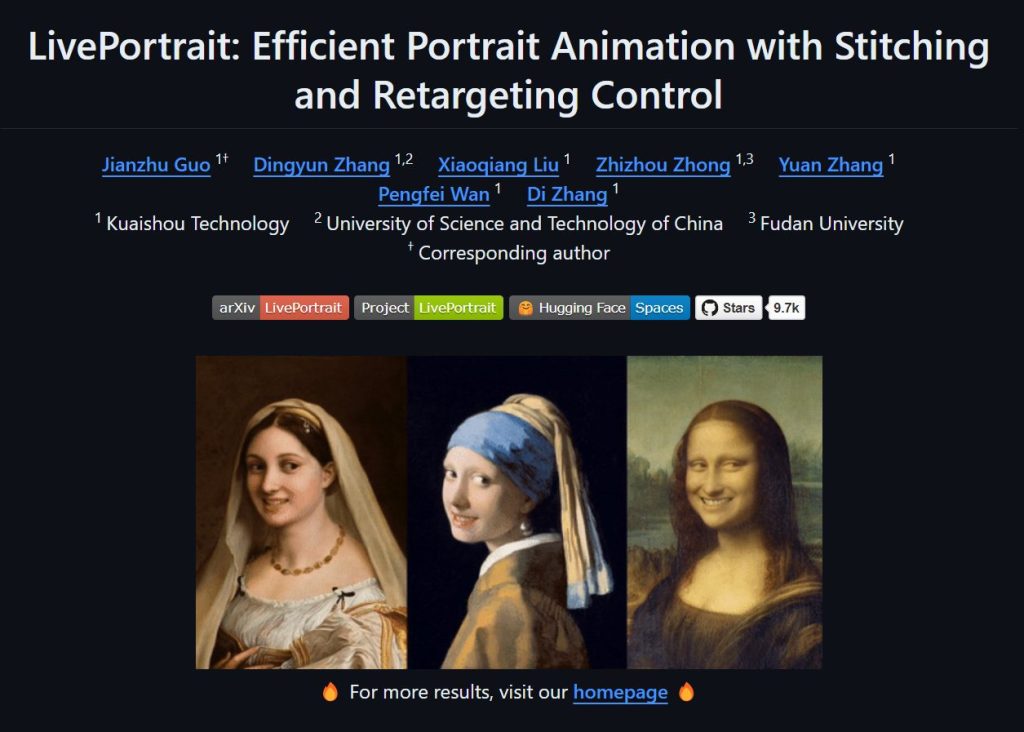

LivePortrait 是一個先進且有趣的影像生成技術,它不僅讓靜態肖像圖片動起來,變得栩栩如生,還能讓用戶在不同的角色之間進行變換,甚至能做到將一位大叔轉變成美女,美女變會跳舞的效果。這項技術目前在GitHub上獲得了10K顆星的高度關注,顯示了它在開源社群中的受歡迎程度。

什麼是 LivePortrait?

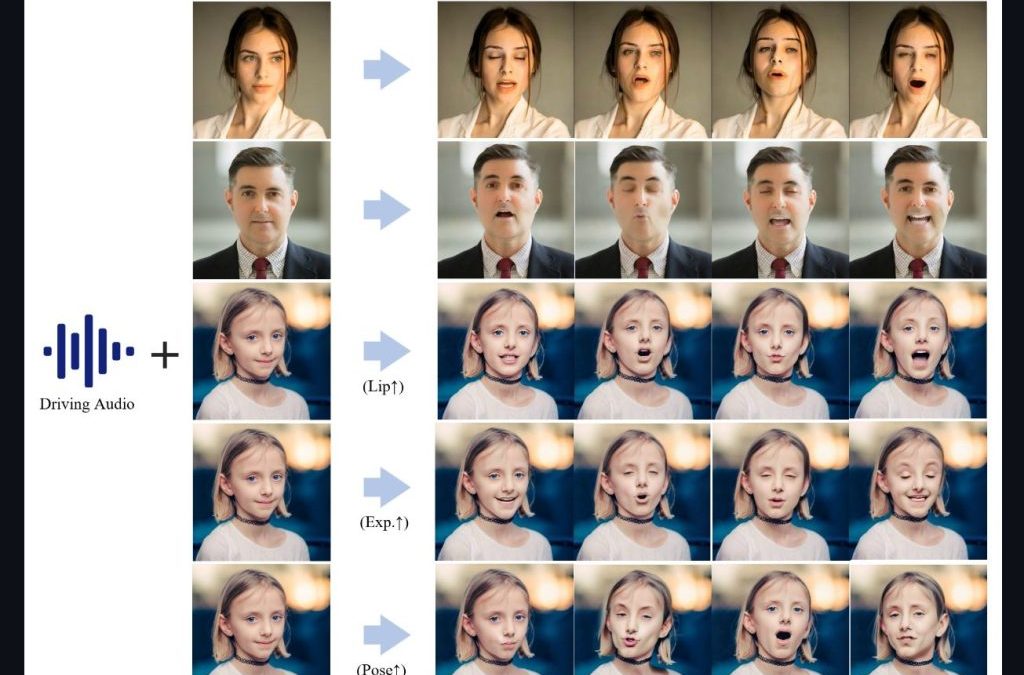

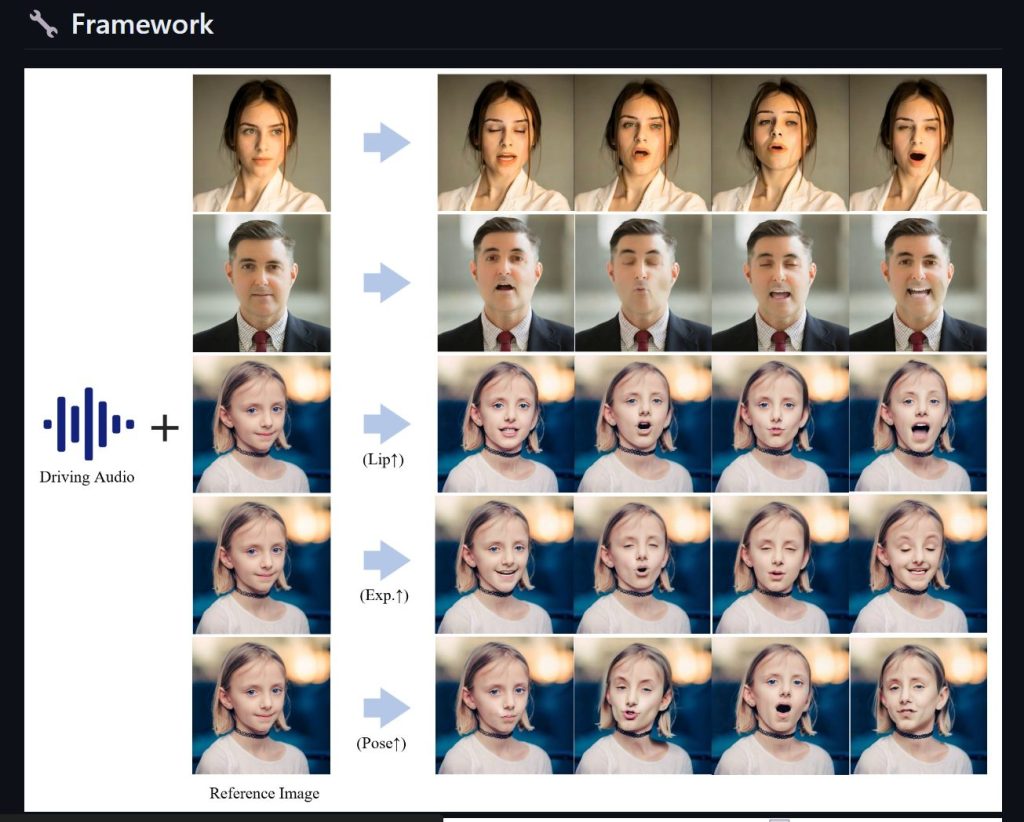

LivePortrait 是一個能夠讓靜態人像圖片進行動畫化的技術。該技術的核心是將人臉動作從一個人像轉移到另一個人像上,從而實現讓靜態圖片「動起來」的效果。與傳統的動畫技術相比,LivePortrait 的計算效率更高,並且生成的影像更加自然、流暢。

主要特點

縫合與重定位控制 :LivePortrait 的關鍵特點之一是它的縫合與重定位控制技術。這讓用戶可以將不同的面部特徵縫合到一個目標人像上,並進行動畫化。例如,將一位大叔的臉與美女的臉部特徵進行結合,然後動畫化,達到讓大叔秒變美女的有趣效果。高效的處理能力 :這個技術使用了一種高效的算法,能夠在較短的時間內生成高質量的動畫效果,適合用於即時應用或者在線處理需求。開源社群的熱烈反響 :LivePortrait 的 GitHub 項目自發布以來,已經累積了7.9K顆星,成為了開源社群中的一個熱門項目。這顯示了技術人員與開發者對這項技術的認可與支持。

應用場景

LivePortrait 的應用場景非常廣泛,從娛樂到專業用途都有所涉及。舉例來說,它可以用於製作逼真的動畫表情,為虛擬角色賦予生命,或者在影像特效中實現面部交換等功能。其高度的可定製性也讓它成為許多創意工作者的工具首選。

安裝方法

原始項目網址 https://github.com/KwaiVGI/LivePortrait

安裝程式

git clone https://github.com/KwaiVGI/LivePortrait

cd LivePortrait

# create env using conda

conda create -n LivePortrait python=3.9

conda activate LivePortrait

# 安裝相關依賴

pip install -r requirements.txt 下載預訓練資料

# !pip install -U "huggingface_hub[cli]"

huggingface-cli download KwaiVGI/LivePortrait --local-dir pretrained_weights --exclude "*.git*" "README.md" "docs" 如果不能存取 Huggingface

# !pip install -U "huggingface_hub[cli]"

export HF_ENDPOINT=https://hf-mirror.com

huggingface-cli download KwaiVGI/LivePortrait --local-dir pretrained_weights --exclude "*.git*" "README.md" "docs" 執行視窗

# For Linux and Windows users

python inference.py

# For macOS users with Apple Silicon (Intel is not tested). NOTE: this maybe 20x slower than RTX 4090

PYTORCH_ENABLE_MPS_FALLBACK=1 python inference.py 指令碼

# source input is an image

python inference.py -s assets/examples/source/s9.jpg -d assets/examples/driving/d0.mp4

# source input is a video ✨

python inference.py -s assets/examples/source/s13.mp4 -d assets/examples/driving/d0.mp4

# more options to see

python inference.py -h 超酷的寵物模式

先安裝寵物模式

cd src/utils/dependencies/XPose/models/UniPose/ops

python setup.py build install

cd - # equal to cd ../../../../../../../ 要使用的時候只需要下

python inference_animals.py -s assets/examples/source/s39.jpg -d assets/examples/driving/wink.pkl --driving_multiplier 1.75 --no_flag_stitching Huggingface 上使用

https://huggingface.co/spaces/KwaiVGI/LivePortrait

參考資料

VIDEO

by Rain Chu 6 月 27, 2024 | AI , 人臉辨識 , 影片製作 , 語音合成

主要功能介紹:

語音動畫同步 :用戶只需上傳一張照片及一段WAV格式的英語語音,Hallo AI就能使照片中的人物按語音內容進行動作,包括說話和唱歌。動作自然流暢 :結合精確的面部識別和動作捕捉技術,保證人物動作的自然流暢,令人印象深刻。

技術框架:

音頻處理 :使用Kim_Vocal_2 MDX-Net的vocal removal模型分離語音。面部分析 :透過insightface進行2D和3D的臉部分析。面部標記 :利用mediapipe的面部檢測和mesh模型進行精確標記。動作模組 :AnimateDiff的動作模組為動作生成提供支持。影像生成 :StableDiffusion V1.5和sd-vae-ft-mse模型協同工作,用於生成和調整圖像細節。聲音向量化 :Facebook的wav2vec模型將WAV音頻轉換為向量數據。

安裝方法

盡量採用 Linux 平台,我這邊測試成功的有 Ubuntu 20 WSL 版本,就可以簡單三個步驟,部過前提要記得先安裝好 WSL CUDA 支援

1.建立虛擬環境

conda create -n hallo python=3.10

conda activate hallo 2.安裝相關的依賴

pip install -r requirements.txt

pip install . 3.要有 ffmpeg 支援

4.測試與驗證

python scripts/inference.py --source_image examples/reference_images/1.jpg --driving_audio examples/driving_audios/1.wav 最近更新:

在🤗Huggingface空間克隆了一個Gradio演示。

新增Windows版本、ComfyUI界面、WebUI和Docker模板。

參考資料

Hallo GitHub

Hallo Model

大神開發的Windows介面

Hallo 線上版本

Hallo Docker版

影片跳舞合成

by Rain Chu 11 月 8, 2023 | AI , 人臉辨識 , 圖型處理 , 影片製作 , 繪圖

Rope以其令人矚目的功能,站在了這場技術革新的前沿。這款AI工具不僅能夠輕鬆去除臉部遮擋,更整合了多種高清化算法,讓處理速度快如閃電。然而,在介紹如何安裝和使用Rope之前,我們必須提醒每一位用戶:這項強大的技術應當用於正當的創造和學術研究,千萬別拿去做壞事。現在,讓我們詳細了解如何在您的本地設備上安裝並運行Rope。

安裝必要軟體 在開始使用Rope之前,需要先安裝一些必要的軟體:

安裝Python

安裝FFmpeg

FFmpeg是處理影片不可或缺的組件,可以通過命令行進行安裝,或是參考我之前的ffmpeg教學 。

Nvidia顯卡安裝CUDA

為了充分發揮Rope的性能,Nvidia顯卡用戶應安裝CUDA 11.8 ,這對於AI運算至關重要。

安裝Rope 安裝了必要的軟體後,便可以開始安裝Rope:

下載Rope壓縮包

安装visual studio 2022 創建虛擬環境

使用Python建立一個新的虛擬環境,這有助於管理依賴包和版本。

python -m venv venv

啟動虛擬環境

透過命令行啟動虛擬環境,準備安裝Rope。

call venv\scripts\activate.bat

安裝依賴包

在虛擬環境中,使用pip指令安裝Rope需要的所有依賴包。

pip install -r requirements.txt

如果安裝失敗,要先執行下面的指令

pip install –no-cache-dir -r requirements.txt

pip uninstall onnxruntime onnxruntime-gpu

pip install onnxruntime-gpu==1.15.0

下載換臉模型

透過這些步驟,您可以在本地機器上成功安裝和配置Rope,並開始進行高效的臉部轉換。隨著AI技術的快速發展,Rope提供了一個既方便又強大的工具,使創意和創新更加無限。

操作指南:如何使用Rope進行批量換臉 請先確認安裝 Rope 已經成功,接著,遵循以下步驟來執行Rope的批量換臉功能:

打開命令提示字元

進入Rope的本地根目錄

激活虛擬環境

通過執行call venv\Scripts\activate.bat指令來激活Rope的Python虛擬環境。

運行Rope主程式

使用python run.py --execution-provider cuda指令,開始執行批量換臉處理。

自定義選項:提升處理質量與效率 Rope提供多個可選參數來滿足用戶的特定需求:

面部增強

加入face_enhancer選項,可以對換臉後的面部進行增強處理,使其更加清晰細緻。

python run.py –execution-provider cuda face_enhancer

調整輸出視頻質量

使用--video-quality選項並指定一個0到50的數值(數值越小,輸出質量越高)。

python run.py –execution-provider cuda –video-quality 1

指定內存使用

若需要管理程序的內存使用,可透過--max-memory選項設定最大內存限制。

python run.py –execution-provider cuda –max-memory 16

指定執行線程

對於較老的Nvidia顯卡,可使用--execution-threads來指定執行線程數,以達到最佳運行效能。

python run.py –execution-provider cuda –execution-threads 2

預設是4

使用方法可以看YT

Rope又一款强大的一键换脸AI!可消除脸部遮挡,多种高清化算法,飞一般的处理速度!本地安装与参数使用详解。 – YouTube

解除roop检测深度换脸 – YouTube https://www.youtube.com/watch?v=YH4hB3wmRcQ

roop新奇用法:一键直播换脸、批量换图 – YouTube

Rope 分支

https://github.com/Hillobar/Rope/

https://github.com/s0md3v/sd-webui-roop

近期留言